在生物医学等专业领域进行NLP模型训练时,除了特定数据集外,「域外」文本也常被认为有其价值。然而,微软的研究人员对此提出了异议。

预训练究竟是什么?

这是一个常常让人工智能新手感到困惑的问题。

作为人类,我们不需要从零开始学习,而是通过已有的知识来理解新信息和处理新任务。

在人工智能的背景下,预训练正是模拟这一学习过程。

预训练(pRe-tRAIning)是一个在研究文献中频繁出现的术语,指的是通过一个特定任务训练模型,以形成可在其他任务中应用的参数。

这种方式可以用已经学习过的任务的模型参数来初始化新任务的模型参数,使得旧知识能够帮助新模型有效地完成新任务,而无需从头开始。

过往的研究表明,在如生物医学这样的专业领域,使用特定领域的数据集能够提高NLP模型的准确性,但普遍认为「域外」文本同样重要。

然而,微软的研究团队对此提出了不同的看法。

近期,他们展示了一种新技术,专门针对生物医学NLP的领域特定语言模型进行预训练,并自信地表示,通过从公开数据集中编制一个全面的生物医学NLP基准,在命名实体识别、基于证据的医学信息提取、文档分类等任务上取得了领先的成果。

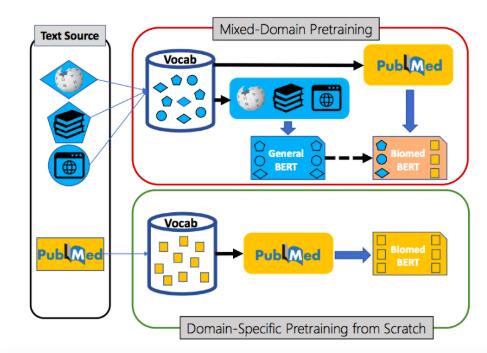

他们认为,「混合领域」预训练实际上只是迁移学习的另一种表现形式,其中源领域为一般文本(如新闻),而目标领域则为特定文本(如生物医学论文)。

基于此,针对生物医学的NLP模型的预训练表现始终优于通用语言模型的预训练,表明「混合领域」预训练并非完美。

神经语言模型预训练的两种方式。「混合领域」预训练(上);仅使用领域内文本进行预训练(下)

研究人员的信心来源于充分的证据。

他们通过分析生物医学NLP应用的影响,对比了训练前的模型构建与特定任务的微调过程。

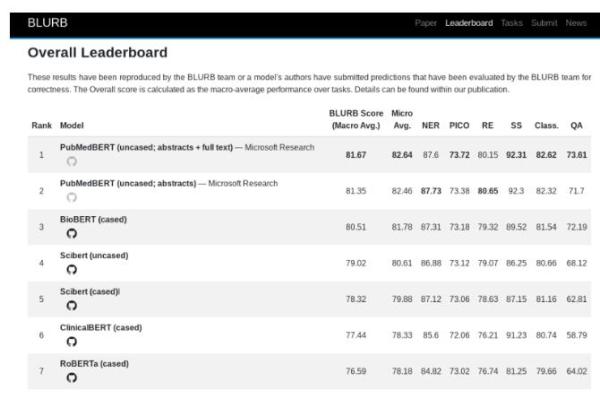

首先,他们创建了一个名为生物医学语言理解与推理基准(BLURB)的标准,侧重于来自PubMed(一个生物医学相关数据库)的出版物,涵盖关系提取、句子相似度和问题回答等任务,以及是/否问题回答等分类任务。为了计算综合得分,BLURB中的语料库按任务类型进行分组并分别评分,最后计算平均值。

在评估中,他们使用最新的PubMed文档生成词汇表并训练了一个模型:1400万篇摘要和32亿个单词,总计21GB。该模型在一台配备16个V100显卡的NVIDIA DGX-2机器上训练了大约5天,具有62,500步长和批量大小,与以往生物医学预训练实验所需的计算量相当。

此外,研究人员自豪地表示他们的模型——PubMedBERT,是基于谷歌的BERT构建的。

这个强大的BERT模型,是Google在2018年提出的,成为近年来NLP领域的一项重要技术突破。

有趣的是,将PubMed的全文(168亿字)添加至预训练文本中反而略微降低了性能,尽管延长预训练时间有所改善,但研究人员将此现象归因于数据中的噪声。

「在这项研究中,我们挑战了神经语言预训练模型中普遍接受的假设(即前述的「混合领域」预训练),并证明从无到有进行特定领域预训练显著优于「混合领域」预训练,」研究人员指出,「这为生物医学NLP应用带来了新的最先进结果,我们将继续探索特定领域的预训练策略,并计划将BLURB基准扩展至临床或其他高价值领域。」

为了促进生物医学NLP的研究,研究团队创建了一个以BLURB基准为特色的排行榜,并以开源形式发布了预训练的特定任务模型。

该研究结果已在预印本网站aRxiv上发表。