相同的面孔,却能搭配不同的声音,并且实现高度同步。

当DeepFake技术用于口型替换时,效果是这样的。

你有没有注意到这几个人的语音和语调完全一致。

闭眼听,根本无法判断出说话者是谁?是吴恩达还是马斯克?到底是谁在发声?

与原视频相比,面部表情变化微乎其微,效果显得十分自然。

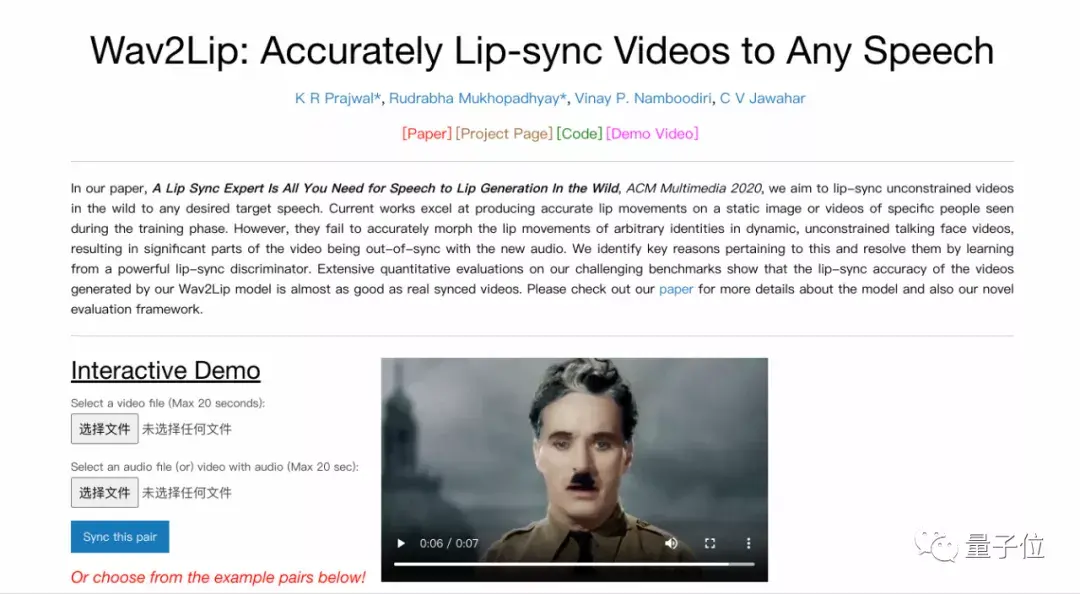

这项新研究来自印度海德拉巴大学,提出了一种名为Wav2LIP的模型,旨在生成准确的唇语同步视频。

无论是任何角色,包括卡通形象,任何声音和语言,都能将口型视频高精度地与目标语音同步。

目前该项目已经开源,大家可以体验DEMO版,只需上传20秒的视频和音频文件,即可一键生成。

该研究在ReddIT上发布后,21小时内便获得了超过200的热度。

针对这项研究的应用前景,研究者表示,可以广泛应用于外语在线讲座、配音电影和新闻发布会,使得角色与声音的结合更加自然,同时节省大量的人力和物力。

Wav2LIP模型

目前的研究主要集中在静态图像或特定人物的视频中生成准确的唇语动作。

然而,现有技术在动态图像中,例如正在说话的人物的唇部动作变形方面存在困难,导致内容与新音频无法完全同步。

就像观看一部音画不同步的电影时,常常让人感到不适。

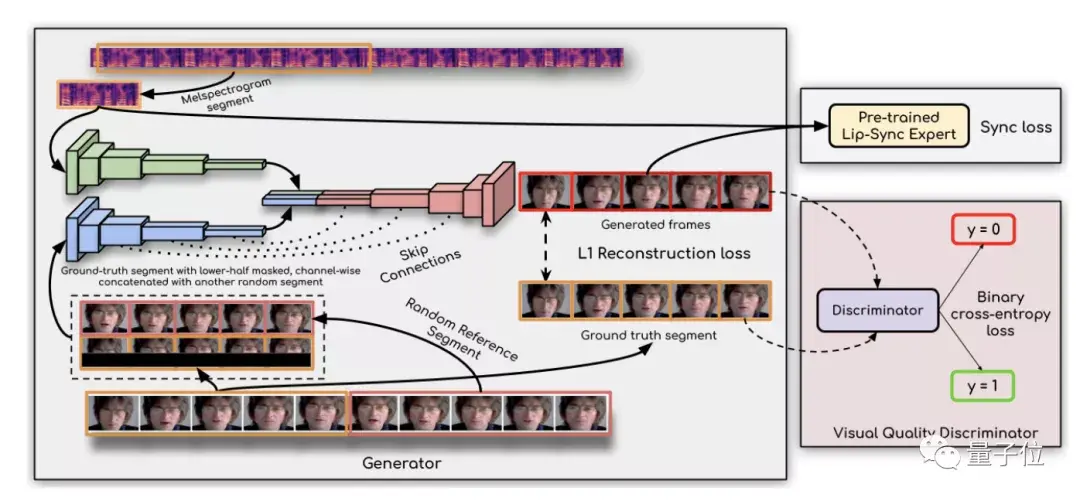

因此,研究人员找到了解决这一问题的关键,并通过一个“唇语同步辨别器”来应对。

具体来说,两个关键原因导致了这一问题:当前研究中使用的损失函数,如L1重构损失和LIPGAN中的判别器损失,无法有效减少错误的唇语同步生成。

因此,研究人员引入一个预先训练的判别器“well-tRAIned lIP-sync expeRt”,用以检测唇语同步的错误,这一判别结果相当准确。

此外,研究者发现,在噪声较大的面孔上进行进一步微调,会影响判别器测量唇部同步的能力,从而影响生成的唇形。

最终,他们还采用视觉质量鉴别器来提升视觉质量和同步精度。

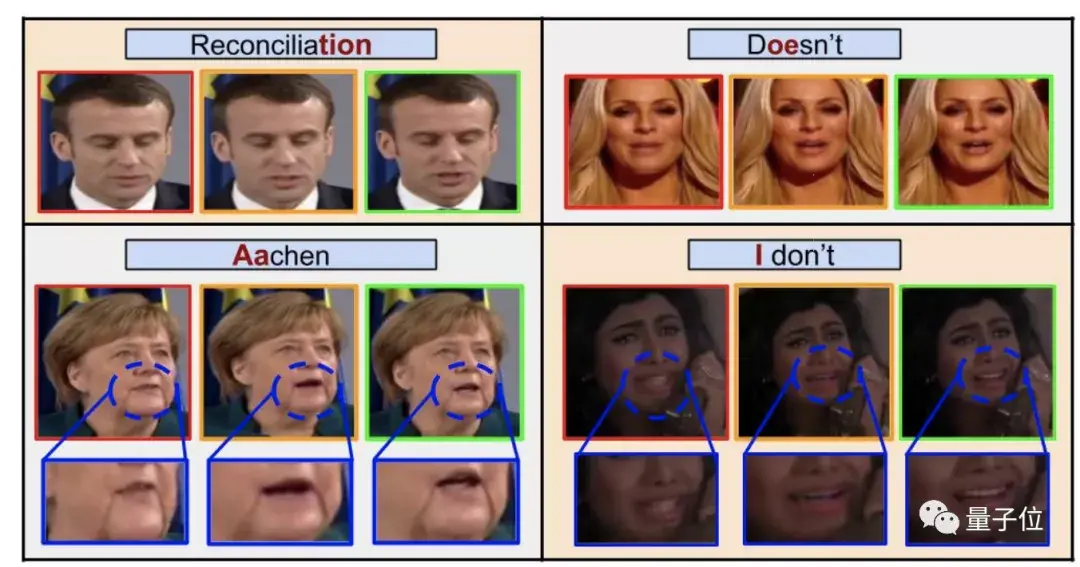

以一个例子说明,黄色和绿色框代表本次提出的模型,而红色框则为现有的最佳方法,旁边是他们正在说的句子。

可以看到,模型生成的唇形比现有方法更为准确和自然。

模型训练结果

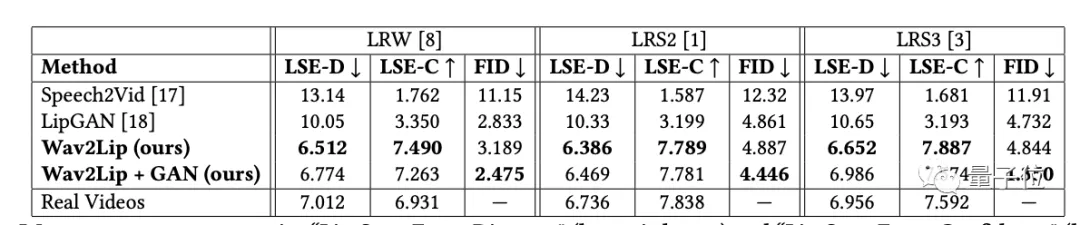

在模型训练阶段,研究者提出了两个新指标,“LIP-Sync Error-Distance”(数值越低越好)和“LIP-Sync ERRoR-Confidence”(数值越高越好),用于衡量视频中的唇语同步精度。

研究结果显示,使用Wav2LIP生成的视频几乎与真实的同步视频无异。

需要指出的是,该模型仅在LRS2训练集上进行训练,若需在其他数据集上使用,代码需进行少量修改。

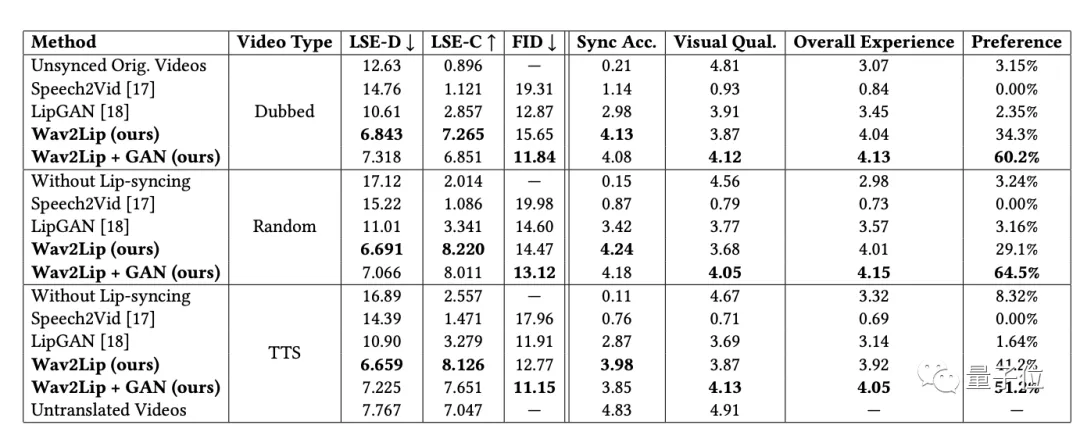

进一步评估了三种现实视频类型。

结果显示,Wav2LIP模型均能生成高质量和准确的唇语同步视频,但在对TTS生成的语音进行唇语同步时,仍有改进空间。

你对这项研究有什么看法?

目前,该项目已经开源,欢迎大家体验DEMO版哦!

再次提醒:只需上传20秒的视频和音频文件,即可一键生成!