微软研究院最近展示了 Rumi 项目,该项目通过整合文本、音频和视频数据,采用多模态的方法提升人工智能系统的理解能力,以更好地捕捉人类的意图。

近年来,人工智能系统在各个领域取得了显著进步,尤其是在自然语言处理(NLP)方面的表现尤为突出。然而,现有的 NLP AI 主要依赖于文本输入和输出,往往忽略了自然交流中所包含的语调、面部表情、手势和肢体语言等重要线索,这使得其理解能力受到一定限制。

在人工智能的专业术语中,这些重要的线索被统称为副语言。

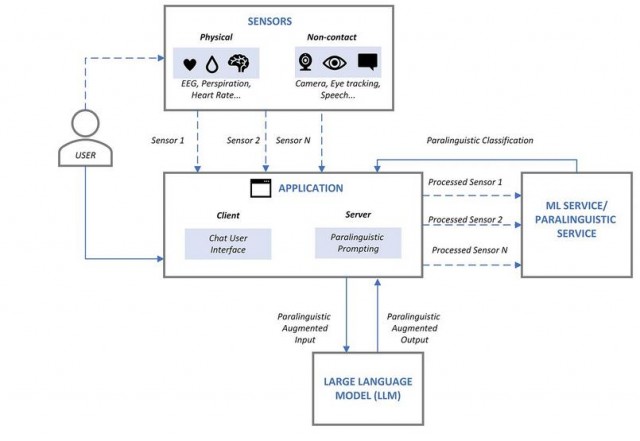

为了解决这一挑战,微软研究院开发了 Rumi 项目。这个创新的框架旨在通过多模态副语言提示来增强人工智能的理解能力。该项目由两个主要部分组成:多模态副语言编码器和多模态副语言解码器。