要构建一个自动驾驶控制系统,需要多少个神经元呢?

麻省理工学院的研究人员给出的答案是,仅需19个!他们的研究灵感来自于线虫这一基础生物。

最近,来自麻省理工学院计算机科学与人工智能实验室、维也纳工业大学和奥地利科技学院的团队开发了一种新型人工智能系统,该系统基于线虫的大脑。相关研究成果已发表在《自然·机器智能》期刊上。

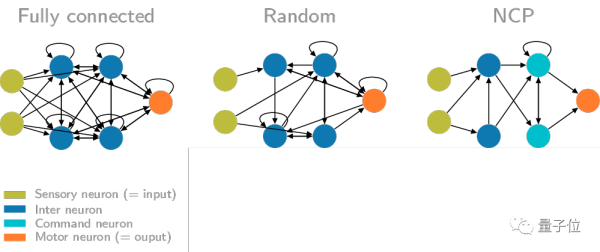

研究团队发现,单个算法仅需19个控制神经元,通过253个突触连接32个输入特征到输出,能够学习如何将高维输入映射到操纵指令。

这一新型AI系统使用极少的人工神经元实现车辆转向,而相比之下,基于长短期记忆(LSTM)的神经网络构建同样的自动驾驶系统则要复杂得多。

那么,为什么可以只用这么少的神经元呢?论文的共同作者、麻省理工学院的博士后RaMin Hasani对此做出了解释:

与传统深度学习模型相比,每个单元内信号的处理遵循不同的数学原理。

研究团队受到秀丽隐杆线虫的启发,在2018年提出了一种神经元回路策略(NeuRonal CiRcuIT Policies,NCP)。

NCP方法通过重新利用生物神经回路模型的功能,创建出可解释的智能体控制系统,适用于管理虚拟和现实世界中的强化学习测试平台。

该方法模拟了线虫的TW神经回路,该回路主要负责线虫对外部机械刺激的反射反应。通过掌握突触和神经元的参数,NCP为基本强化学习任务提供了控制策略。

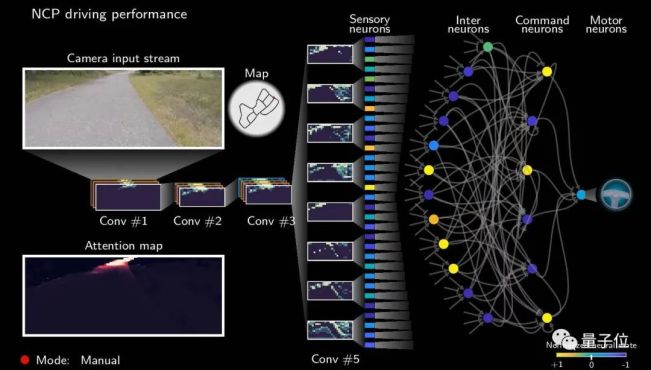

为验证这一新数学模型,研究团队选择了一项关键的测试任务——确保自动驾驶汽车保持在车道中间。神经网络通过摄像机获取道路图像,并自动决定转向方向。

通常,像自动驾驶这样的复杂任务需依赖数百万个参数的深度学习模型。然而,NCP方法可以将网络规模缩小两个数量级。

这个基于19个神经元的极简自动驾驶系统仅使用了75,000个训练参数,参数数量的减少达到了两个数量级。

NCP方法构建的自动驾驶系统也需要处理来自摄像机的视觉数据,并从中提取结构特征,但并不直接与车辆的实际转向相关。

后续的神经网络负责判断摄像机图像中哪些部分重要,并将信号传递给NCP控制系统。

控制部分将感知系统中的数据转化为转向命令,仅由19个神经元组成。

两个子系统相互堆叠并同时进行训练,训练数据集来源于波士顿地区的汽车行驶视频,其中包含图像与汽车转向操作的关联数据。

通过将两者一起输入网络,系统最终学会了自动将图像与适当的转向操作联系起来,从而能够独立应对新情况。

除了结构的简洁性,NCP设计的自动驾驶系统相比传统模型还有两大优势:可解释性和鲁棒性。

系统的可解释性使我们能够观察到网络关注的重点。

从视频中可以看到,神经网络专注于图像中的具体部分,例如路边和地平线。这种行为在AI系统中是独特的。

此外,系统的可解释性深入到每个神经元的功能。我们能够观察到哪些神经元(视频中亮起部分)在驾驶决策中起到作用,从而更好地理解单个神经元的功能及其行为。

为了评估传统模型与NCP模型的鲁棒性,研究人员还对输入图像进行了扰动,并评估智能体对噪声的处理能力。结果表明,NCP模型展现出强大的抗干扰能力。

除了可解释性和鲁棒性,NCP模型还具有其他优势,如缩短训练时间,降低在相对简单系统中实现AI时的不确定性。

RaMin Hasani博士表示,NCP不仅适用于自动驾驶,还可以应用于更广泛的领域,例如仓库自动化机器人等。