人工智能技术正在迅速被各行各业的企业所采用,预计在未来三年内,企业在人工智能系统上的支出将翻倍。然而,尽管人工智能系统功能强大,其部署却并非易事,且可能带来业务和客户风险。

近期关于信贷、招聘和医疗保健领域的人工智能应用的新闻报道中,突出了一个主要风险,那就是潜在的偏见。因此,一些企业受到监管机构的监督,以确保其人工智能模型的公平性。

机器学习模型通常通过历史数据进行训练,以预测未见数据的结果。然而,训练数据可能因多种因素而存在偏见,例如,某些受保护群体的样本数量不足,或者在数据整理过程中无意中引入的人为偏见。不幸的是,使用有偏见的数据进行训练的模型,往往在其决策中延续了这种偏见。

确保业务流程的公平性并非新鲜事物。例如,美国政府在1970年代实施了公平贷款法(如《平等信贷机会法》(ECOA)和《公平住房法》(FHAct)),以禁止在信贷和房地产交易中出现歧视。此外,《同酬法》、《民权法》、《康复法》、《就业年龄歧视法》和《移民改革法》都为防止对某些受保护群体的歧视提供了广泛的保护。

构建公平的人工智能系统需要经过两个步骤:理解偏见和解决潜在的偏差。本文将重点讨论第一个方面。

了解偏见

在解决问题之前,首先要识别其存在。没有企业会故意让其人工智能系统对用户产生偏见。相反,偏见的引入通常是由于模型开发过程中的缺乏意识和透明度所致。

以下是一些最佳实践,旨在更好地理解和减少机器学习开发过程中产生的偏见。

获取主要利益相关者的支持

一个不公平的系统与一个可能带来重大业务影响的安全风险类似。实施公平治理流程需要投入资源。如果没有领导团队的支持,所需的开发能力可能无法超越其他业务优先级。因此,建立强有力的公平导向人工智能流程,首先需要获得所有利益相关者的认可,包括管理团队。

任命“内部捍卫者”

在获得支持后,任命一名负责建立公平程序的倡导者十分重要。该倡导者需要在包括法律和合规代表在内的各个团队之间进行沟通,制定与公司特定领域(如医疗保健、招聘等)和具体用例(如重新住院建议、保险费评估、信用评估等)相关的准则。有多种偏见度量标准可供选择,例如机会均等和人口统计均等,具体选择应依据用例而定,并由从业者掌握。

一旦指导方针确定,捍卫者将负责对相关团队进行培训。为了确保可行性,人工智能公平工作流程需关注数据和模型的偏差,并要求访问被评估公平性的受保护属性,例如性别和种族。然而,收集受保护属性通常较为困难,在很多情况下,直接在模型中使用这些属性是非法的。

即使未直接将受保护属性作为模型特征,也存在代理偏见的风险,某些数据字段(如邮政编码)可能与受保护属性(如种族)相关联。在缺少保护属性及其衡量的情况下,识别偏见将变得更加复杂。团队可以通过推断受保护属性来填补这一空白,例如在贷款承保模型中使用普查数据来推断性别和种族。

测量偏差

接下来,我们需要对偏差进行测量。不幸的是,许多机器学习模型的固有不透明性使得偏差的测量变得复杂。人工智能的可解释性研究正在进展,它能够揭示人工智能模型内部的运作机制,从而实现对偏差的透明评估,确保人工智能驱动的决策是负责任和可信赖的。

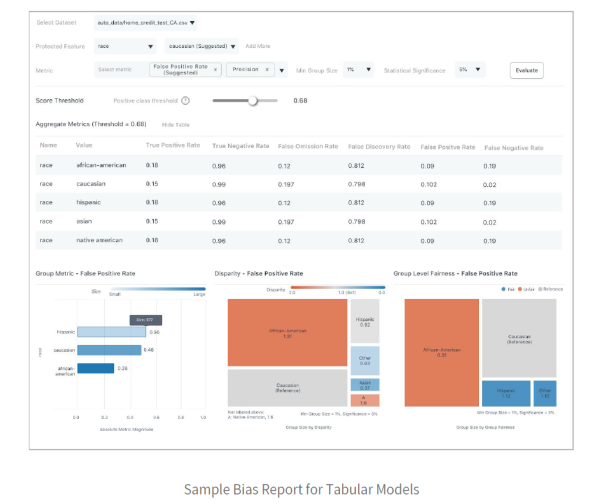

以下是机器学习模型公平报告的一个示例:

该报告用于评估贷款决策中的风险,并包含关于受保护“种族”属性的其他元数据。用户可以利用该报告中的各种公平性指标,查看不同组别的公平性及其影响。建议根据具体用例的需求,关注特定指标(例如,“误报率”)和特定特权类别(例如,白人)来评估偏见。

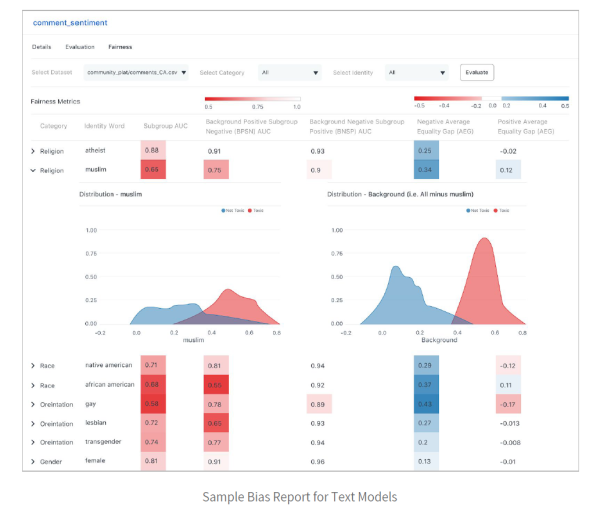

除了贷款模型等表格模型外,文本和图像模型中同样可能存在偏见。例如,以下图展示了一个文本模型,正在测量用户生成的注释的毒性。

下面的样本偏见报告显示了该模型如何评估不同种族和宗教群体的毒性。

注意,热图显示该模型对“女性”和“无神论者”身份群体的偏见相对较小。在这种情况下,机器学习开发人员可能需要向训练集中添加更多有偏见的身份组的代表性样本。

生产模型的公平性考虑

无论模型在部署之前是否存在偏差,一旦模型开始处理实时流量,就有可能出现新的偏差。这种偏差的变化通常是由于部署模型时输入数据的统计特性与训练数据不同。因此,最佳实践是在模型部署后监测相关的偏差指标。以下截图展示了监测模型准确性指标的外观(用于追踪潜在偏差的相关指标之一)。

总而言之,人工智能为量化和解决迄今为止由人主导且不透明的决策系统中的偏差提供了独特的机会。