安全和隐私问题是人工智能应用中最大的挑战,原因显而易见。无论是良性还是恶意行为者,都可能对AI模型及其数据的公正性、安全性和隐私造成威胁。

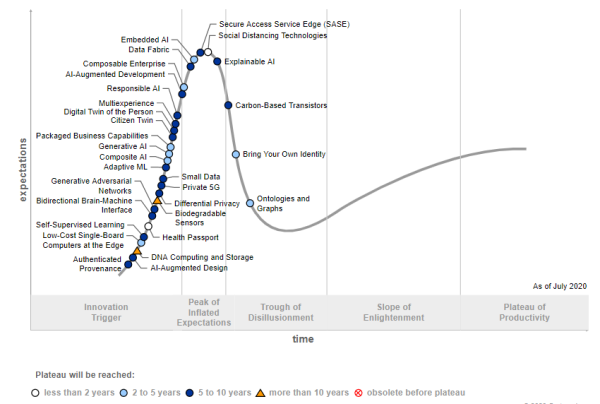

随着人工智能逐渐普及并承诺带来一系列好处,企业必须重视这一发展趋势。根据2020年Gartner新兴技术发展曲线图,列出的技术中有超过三分之一与人工智能相关。

然而,人工智能潜藏的阴暗面常常难以应对,尤其是当前市场上缺乏一致或全面的工具来维护企业和个人的权益。更令人担忧的是,根据Gartner的一项调查,消费者普遍认为,使用或提供人工智能的企业在问题出现时应承担责任。

为保护人工智能投资而实施安全措施符合每个组织的利益。AI面临的威胁和攻击不仅危害模型的安全性和数据保护,还可能影响其性能和结果。

犯罪分子通常通过两种方式攻击AI,技术人员可以采取措施来减轻这些威胁,但首先让我们分析人工智能的三大核心风险。

人工智能的安全性、责任性和社会风险

使用人工智能的组织面临三种主要风险。随着AI的普及并融入关键企业运营,安全风险正在加剧。例如,自动驾驶汽车的AI模型中可能存在导致致命事故的缺陷。

随着越来越多的AI模型使用敏感客户数据并影响客户决策,责任风险也在上升。例如,错误的AI信用评分可能会阻碍消费者获得贷款,进而造成财务和声誉损失。

社会风险则伴随“不负责任的人工智能”而增加,这种AI做出的决策往往不透明且难以理解,给消费者带来不公正的后果。即使是微小的偏差,也可能导致算法出现严重错误。

罪犯如何攻击AI

上述风险通常是通过犯罪分子对AI的两种常见攻击方式造成的:恶意输入和调查攻击。

针对AI模型的恶意输入可能表现为对抗性AI、操纵数字输入或恶意物理输入。对抗性AI可能使用生成的声音进行社会工程攻击,成为新型网络钓鱼的工具。例如,去年3月,犯罪分子利用AI合成语音模仿CEO,试图通过欺诈方式转移243,000美元。

调查攻击则是犯罪分子向组织的AI模型发送查询以了解其内部工作原理,这可能表现为黑匣子或白匣子攻击。具体来说,黑匣子攻击识别出不常见的输入扰动,以获得特定输出,如财务收益或避开检测。部分研究者已成功通过操纵输出欺骗领先的翻译模型,造成翻译错误。

白盒攻击则可能重新生成训练数据集以重现相似模型,导致有价值数据被盗。例如,某语音识别供应商成为受害者,被新的外国供应商伪造其技术并进行市场销售,从而使其失去市场份额。

提高AI可信赖性的最新安全支柱

对于IT领导者而言,识别组织中对人工智能的威胁十分重要,以便评估和加强现有的安全支柱(以人为中心和企业安全控制)以及新的安全支柱(AI模型和数据的完整性)。

AI模型的完整性鼓励组织探索对员工进行对抗性培训,并通过企业安全控制来减少攻击面。利用区块链追踪AI模型的来源及其训练数据,也是增强AI可信赖性的一种方法。

AI数据完整性则侧重于数据异常分析(如分布模式和异常值)以及数据保护(如差异隐私或合成数据),以应对对AI的威胁。

为了确保AI应用的安全,专注于安全技术和基础设施的专业人员应采取以下措施:

通过进行威胁评估和实施严格的访问控制,监测训练数据、模型及数据处理组件,以最大程度地减少AI应用在开发和生产期间的攻击面。针对四个特定于AI的方面增强保护软件开发生命周期(SDLC)的标准控制:模型开发过程中的威胁、AI模型缺陷的检测、对第三方预训练模型的依赖以及公开的数据管道。通过保护和维护最新、高质量的对抗性样本数据存储库,防御所有数据管道中的数据中毒。当前越来越多的开源和商业解决方案可用以提升对数据中毒、对抗性输入及模型泄漏攻击的抵御能力。

除非欺诈者被发现并对其系统进行取证,否则很难证明AI模型何时遭到攻击。同时,企业不会轻易停止使用AI,因此确保其安全对企业成功实施AI至关重要。将安全性融入系统的成本通常高于从一开始就设计安全系统的成本,因此应尽早采取保护措施。