只需输入两张图片,便能生成高帧率的动态视频?

这两张图像重叠后呈现如下:

而生成的视频效果是这样的:

这得益于视频插帧算法的应用。

通过极限操作,传统老电影可以变得更加流畅,而该名为RIFE的AI算法同样能够轻松实现。

右侧这段经典的探戈舞,是否看起来比左侧更加流畅?

不仅限于老电影,飞行表演中的精彩片段也可以从每秒24帧提升至每秒96帧。

这项新研究由旷视与北京大学联合完成,除了能够满足公众对高帧率视频的需求,支持2X/4X/8X高质量插值外,它还有一个显著特点:速度快。

量子位在Colab上使用T4运行了一次DEMO,将一个时长53秒的720p 25fps视频插值到100fps,仅花费了2分19秒。

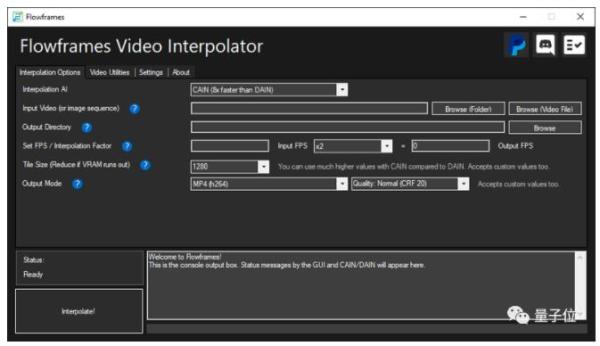

该项目目前已开源,并提供官方DEMO和第三方Windows应用供用户体验。

网友们在看到RIFE的表现后纷纷惊叹,这是否意味着它将超越常见的视频修复插帧AI DAIN,引领新的潮流?

很快,RIFE在ReddIT上的讨论热度飙升至2.8k。

那么,这种效果究竟是如何实现的呢?

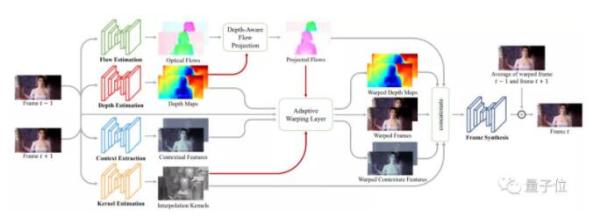

从双向估计到预测中间帧

视频插帧通常使用光流预测算法来生成中间帧并插入两帧之间。光流就像是光在流动,通过颜色展示图像中目标的移动方向。

△稀疏光流与稠密光流

传统的光流预测算法通常依赖前后两帧视频来预测中间帧的样子。

在插入预测出的图像后,视频的流畅度会明显提升。

以DAIN算法为例,预测某一时刻的帧需要前后两帧的支持,通过光流预测算法实现。

△DAIN的算法图

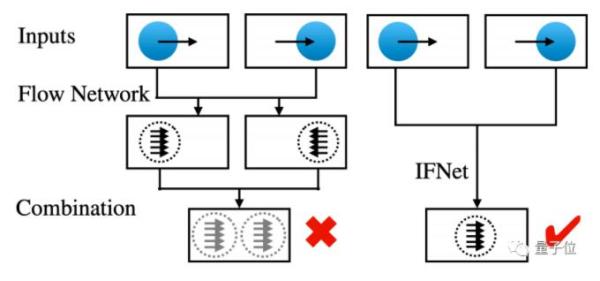

然而,这类算法存在一个缺陷:在预测过程中,如果利用前后两帧图像生成双向光流,再通过线性组合估计中间流,运动边界区域可能会出现伪影。

这些伪影使得重建的中间帧效果不理想。

如果我们尝试一种不同的方法,直接预测中间流,会怎样呢?

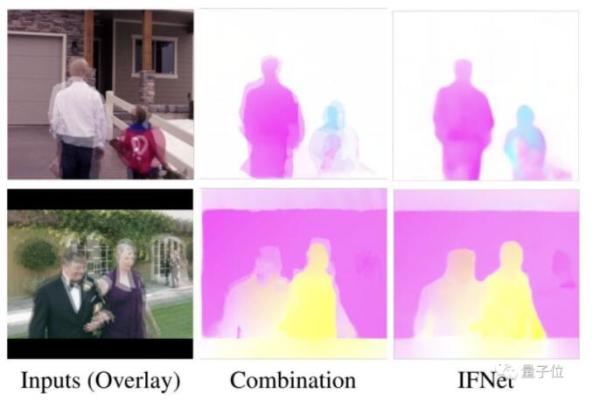

相比于使用前后帧进行两次估计,IFNET(专门高效的中间流网络)算法则直接假设线性运动,对中间帧进行一次估计。

效果显而易见,使用IFNET预测的光流清晰且几乎没有伪影,相较于双向估计的光流效果更佳。

通过这种方式重建图像,不仅光流边缘清晰可见,处理速度也更快。

论文指出,RIFE是首个基于光流的实时视频插帧方案。

由于中间帧的预测采用了线性变换假设,使得每帧的预测减少了一次估计。

那么,这个模型将插帧算法提升到了一个怎样的水平?

运行速度远超其他方法

前文提到,RIFE的一个显著优势是其速度。

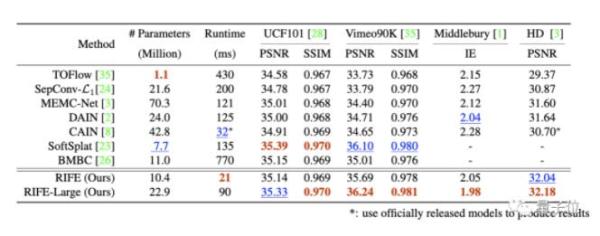

研究人员在多个基准上,将RIFE与英伟达的SoftSplat、上交大的DAIN等进行对比。

测试视频为640×480,使用的GPU是NVIDIA TITAN X(Pascal)。

结果显示,在相似性能下,RIFE基础模型的运行速度超越了所有对比方法。

而RIFE-LaRge模型在性能超越SOTA方法SoftSplat的同时,运行速度快了30%。

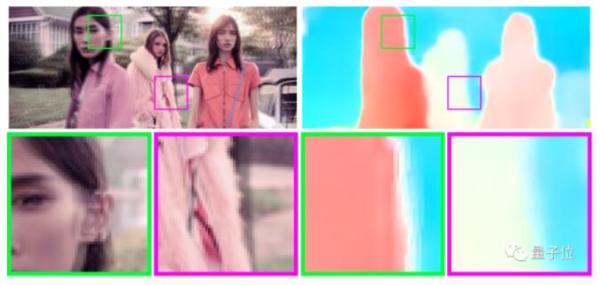

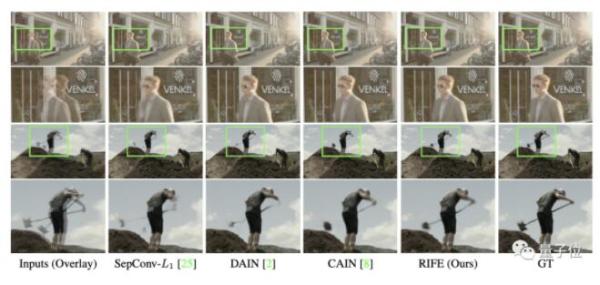

此外,研究人员基于ViMeo90K测试集提供了可视化对比结果。

可以看到,绿色框中,SePConv-L1和DAIN产生了伪影,而CAIN则出现了缺失,相对而言,RIFE的生成效果更为可靠。

安装包和Colab均已提供,试玩无忧

如此出色的模型,用户该如何使用呢?

目前,作者们已提供了预训练模型的多种使用方式,可直接从GITHUB项目下载网盘版压缩包。

无论是使用作者提供的DEMO,还是利用自己想要进行插帧的样本,用户都可以轻松上手。

当然,模型还提供了Colab版本,用户可以直接在云端体验。

此外,已有玩家开发了Windows版软件,用户可直接下载使用,界面简洁:

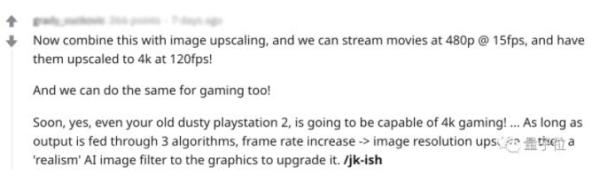

RIFE的出现让一些游戏爱好者兴奋不已:

想象一下,即使是久未使用的PS2,也能实现4K游戏效果!只需三步即可完成!

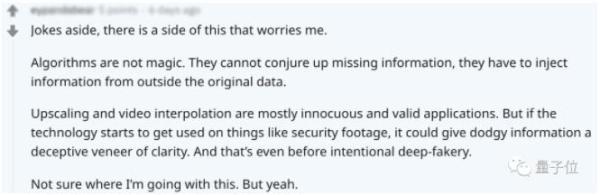

不过,也有网友对这种算法表达了担忧。

尽管其速度快、性能高,但实际上存在一个问题:

该算法本质上无法还原丢失的帧间信息,因此不适用于安防视频。

在这方面的应用仍需进一步探讨。

作者介绍

黄哲威,论文一作,现为旷视的算法研究员,毕业于北京大学。

他在北大信科学习一年后获得ICPC区域赛金牌,并成为旷视科技智能计算组的实习生,之后在NIPS 2017的学习竞赛中使用AcTor-CRITic EnSEMble算法获第二名。此外,他的论文也被ICCV 2019收录。

张天远,毕业于北京大学,其论文曾被ICML 2019、ICCV 2019、NIPS 2019等顶会收录。

衡稳,获得北京大学计算机应用技术硕士学位。

施柏鑫,来自北京大学,目前是北京大学信息科学技术学院的助理教授(博雅青年学者)、研究员、博士生导师。

周舒畅,旷视研究院AI计算组组长,本科毕业于清华电子系,博士毕业于中科院计算所,曾在NeuIPS 2017学习竞赛中获得第二名,并在美国国家标准技术研究所NIST TRAIT 2016 OCR大赛中获胜。

项目地址:

https://Rife-vfi.Github.io/

论文地址:

https://aRxiv.oRg/abs/2011.06294

与DAIN效果对比:

https://www.YouTube.coM/Watch?v=60DX2T3zyVo&aMp;featuRe=youtu.be