近期,GPT-3引起了广泛关注!你可能已经在网络上见识过各种关于GPT-3的展示。这一由OpenAI开发的大型机器学习模型,不仅能够撰写论文,还能作诗,甚至帮助你编写代码。

接下来,让我们先来看看GPT-3在问答任务方面的表现:

无论是富有创意的脑筋急转弯,还是严谨的数学问题,GPT-3都能游刃有余地回答。

开发者ShaRif ShaMeeM利用GPT-3制作了一个生成器,只需输入所需的布局,它便能为你生成JSX代码,如视频所示。

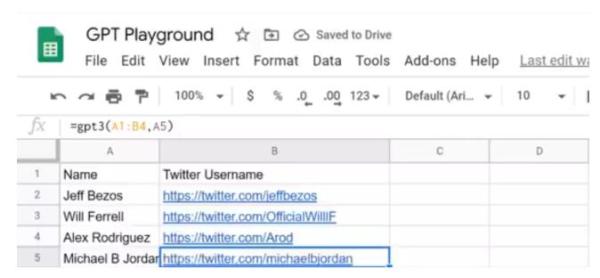

此外,还有人在Google表格中开发了一种新的GPT-3函数,该函数不仅能进行简单的数学计算,还能自动查找美国各州的人口和创建年份:

不仅如此,它还可以帮助你查找Twitter账号:

不过,如果你想试用GPT-3,必须先获得体验资格。然而,通过这个模型创建的应用似乎潜力无限,你可以利用纯英语查询SQL数据库、自动注释代码、生成代码、撰写热门文章标题,甚至帮助我写出一篇引人注目的文章。

什么是GPT-3?

GPT-3是一种基于神经网络的语言模型。与大多数语言模型类似,GPT-3在未标记的文本数据集上经过了大量训练(训练数据包括Common Crawl和Wikipedia),通过随机删除文本中的单词或短语,模型必须学习利用周围的词作为上下文来填补缺失的部分。这是一个相对简单的训练任务,却能够产生强大且可扩展的模型。

GPT-3的模型架构是基于单向Transformer语言模型。这种架构在过去2-3年内逐渐流行,著名的NLP模型BERT和GPT-3的前身GPT-2都基于Transformer构建。从架构的角度来看,GPT-3其实并不算新颖!

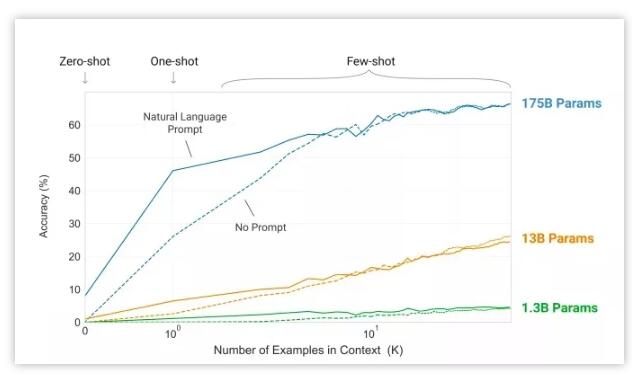

之所以受到如此关注,是因为GPT-3的模型规模达到了1750亿,并使用了45TB的数据进行训练,成为有史以来最大的语言模型。由于其参数模型庞大,它能够完成许多其他模型无法实现的任务,正如前面提到的,你可以让它成为翻译家、作家、诗人或程序员等。

如果你对GPT-3的1750亿参数感到难以想象,那么我给你举个例子,你可能就会明白:

BERT模型有3亿参数,GPT-3的前身GPT-2有15亿参数,英伟达的Megatron-BERT有80亿参数,而微软的Turing NLP则有170亿参数。

连排名第二的微软Turing NLP的参数量都与GPT-3相差甚远。

值得一提的是,这次GPT-3的论文作者多达31位,论文的篇幅更是达到了72页,网友们纷纷感叹,现在的PTM研究似乎开始比拼论文的页数了。