许多人对人工智能(AI)感到兴奋,因为它能够实现自动化、在游戏中超越人类,并提升整体生活水平。这些确实是无可否认的优点,但AI同样存在缺陷和潜在的危险,这些问题可能是人为造成的,也可能源于技术本身。即使在今天,AI带来的扰民或危害生命的事件依然屡见不鲜。这些事件是如何发生的?未来,随着AI的普及,它的哪些潜在特性将对社会构成威胁?

AI算法中的伦理缺陷

AI系统并不完美,其内部存在诸多缺陷,导致伦理问题的出现。这些问题往往与训练数据的偏差相关,进而形成信息反馈循环。以下几个例子可以帮助我们更好地理解这些小错误如何影响现实生活。

1. 面部识别的训练数据偏差

设想一下,你从学校回家的路上,警察突然出现,出示了拘捕令,并把你带到拘留中心。你对自己犯了什么错一无所知,周围的家人和邻居都在注视着你。到达警局后,他们对你进行了全身搜查,取指纹、拍照片,让你在一个肮脏的牢房里度过一夜。你坐在那里,心里充满疑惑。

这是罗伯特·威廉的真实经历。他是一名黑人,在美国法明顿希尔斯无缘无故被逮捕。警方在询问时出示了一张照片,照片中有一名黑人男子在商店偷东西。威廉坚称他从未去过那里,并且照片中的人并不是他。另一张近距离的照片显示的行窃者与他完全不同,他质疑道:“你认为所有黑人都长得一样吗?”警方为何会抓错人?问题在于算法。警方依赖人工智能寻找犯罪嫌疑人,但这一判断显然是错误的。AI本应具备高准确性,但前提是训练数据的质量没有问题。威廉被误认为嫌疑人的主要原因在于训练数据的偏差。面部识别系统对白人相对公平,但对部分群体却缺乏精准性,因为所用的数据集主要包含白人面孔和少数其他种族的面孔,从而导致对黑人的识别率偏低。

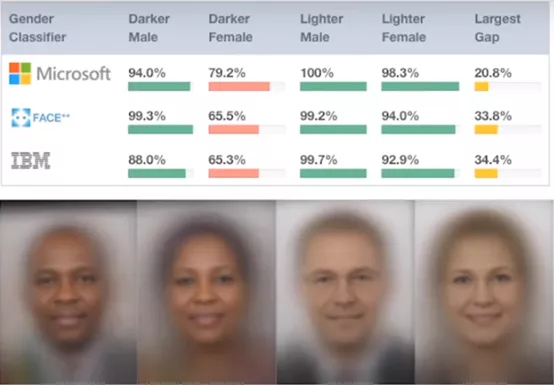

面部识别的准确度差异 | 图源:LeSSon 5 oFFastAI

尽管“深色皮肤男性”的辨识率较高,但深色与浅色皮肤之间的识别仍存在显著差距,尤其是“深色皮肤女性”。这些技术的成果往往来自前沿科技公司,未必是警方所使用的。

2. YouTube的反馈机制

大家都知道YouTube,在平台首页你可能会看到有趣或流行的视频,随着时间推移,你会不知不觉地观看更多视频。这正是推荐系统的作用,它会不断提供能够延长你停留时间的视频,以此增加广告收入。你可能会想:“在这个平台上多待一会儿有什么关系呢?又不会伤害到任何人。”然而,这个推荐算法可能导致危险内容的传播。YouTube的AI反馈循环曾出现过严重的问题:网站的推荐算法使得性侵犯者更容易在特定视频的评论区寻找或分享儿童淫秽作品。这一发现令人震惊,不仅仅是视频被商业化,推荐系统还在不断向成千上万的用户推广儿童内容。反馈循环系统也可能导致信息的单一化,用户可能一直看到他们反感的内容,从而无法接触到对立的观点,进一步加剧社会的两极分化。此外,这种系统还会为阴谋论提供宣传空间,使得对阴谋论稍有兴趣的人更加深信不疑。

3. AI导致医护时间缩短

2016年,阿肯色州的医疗系统引入了一种新的算法,旨在更有效地分配医护资源和时间。虽然提高了医护效率,但也意味着许多本需更多帮助的患者的医护时间被缩减。

该算法未能妥善服务于糖尿病患者或脑麻痹患者,问题源自于算法漏洞和错误代码。这引发了道德问题:我们是否应当允许AI来决定病人的健康状况?为何在未知或未检测出错误的情况下就开始使用该算法?泰米·道博的案例清晰地展示了算法对人们生活的影响。道博多年受到脑麻痹的困扰,2008年搬到阿肯色州后,她需要大量帮助,无法独立移动到轮椅,双手也十分僵硬。正因如此,该州的医疗机构为她分配了每周56小时的照顾时间。

然而,阿肯色州医疗系统引入AI算法后,这一切发生了剧变。道博的医护时间从原来的56小时减少到了32小时!这一削减对她的生活产生了巨大的影响。

AI的不当使用

1. IBM与屠杀

确实,IBM在二战期间帮助纳粹实施了大屠杀。或许你会好奇:“二战有AI吗?”可以说有些相似,IBM研发了一套用于分类的制表系统。这并不是简单的卡片分类算法,而是一个复杂且需要大量维护的工具,虽然不能算是现代意义上的人工智能,但探讨技术的不当使用仍然重要。

回顾这个机器的运作方式:你会拿到一张穿孔卡,将其插入;机器读取信息后保存,并最终输出数字。这些数字决定了人们将被送往哪个集中营、囚犯的类型及其命运。一位名叫霍华德·卡特的经济战首席调查官曾写道:“希特勒的经济战,我们的一家(美)企业也参与其中。因此,IBM与纳粹是同类人,整个世界都被国际恶魔所压迫。”

2. 换脸技术

换脸技术也是一种人工智能应用。它生成的图像、视频甚至音频极为真实,采用的是对抗性生成网络,这是一种深度学习模型。仅仅将换脸用于娱乐目的并无大碍,但其潜在的真实危险和道德问题不容忽视。在政治领域,换脸技术可能被用于制造危害。如果一条推特就能引发紧张局势,那么一段视频或音频又会引起多大的影响?一段侮辱其他政治人物的录音可能在网上迅速传播,导致局势更加紧张。如果人们相信这些内容,结果将不堪设想。另一种社会扰乱方式是用大量虚假内容淹没网络。面对铺天盖地的换脸内容,民众又如何辨别真伪?网络和媒体中满是虚假信息,让人难以分辨事实真相。

此外,换脸技术还可能被用于制造淫秽作品。根据2019年9月的一份报告,网上96%的换脸应用与淫秽内容相关。福布斯的一篇文章提到,换脸型淫秽作品通常未经他人同意,会人工合成明星或知名人士的视频。

浮现出的道德问题

虽然这些现象令人担忧,但更糟糕的可能在后头。AI和技术日新月异,我们最终可能面临一种极权主义的局面。政府的权力将不断增强,它们可以通过AI监控我们的日常活动,面部识别技术将监视我们的每一个动作,麦克风将记录我们的言论,预测算法将判断我们的下一步行动。

这引发了另一个问题,政府越容易追踪个人,就越容易打压异议人士。“下一个希特勒”将高效地找到那些他所厌恶的人,因为他们的行踪已被掌握,随时可被定位。政府也能够识别出反对者,从而更容易地进行惩罚。网络上充斥着虚假的文本和视频,传播的信息往往是最不可信和毫无价值的。我们必须对AI保持警惕。